O Azure Sentinel já estava em Preview a algum tempo (desde março) mas já se mostrava um produto bem interessante https://azure.microsoft.com/pt-br/blog/azure-sentinel-general-availability-a-modern-siem-reimagined-in-the-cloud/?wt.mc_id=4029139

Sua função é analisar os dados coletados pelo Log Analytics e gerar dashboards, reports e alertas customizados com base no Machine Learning.

Nesse primeiro post vamos falar da configuração inicial do Sentinel e seu custo.

Nota: Em um segundo artigo falaremos dos Incidentes (casos), Busca, Notebook, Analise e Guias Estratégicos.

Como Habilitar o Azure Sentinel

Para criar uma instancia do Sentinel é necessário ter o Log Analytics (antigo OMS) habilitado e executando. Se você não o conhece, pode ver o que já abordamos anteriormente em http://www.marcelosincic.com.br/post/Operations-Management-System-(OMS)-agora-e-Azure-Log-Insights.aspx

Não é necessário fazer toda a configuração do Log Analytics, dependerá do que você irá analisar. Por exemplo se analisar DNS mas usa o Azure DNS, Office 365, Azure Activity e outros recursos que já fazem parte do Azure os dados são analisados sem a necessidade de agentes.

Por outro lado se for analisar threats de segurança em geral, login e logoff de AD e segurança de ambiente é necessário ter o agente instalado no Windows ou Linux para coleta dos dados de log.

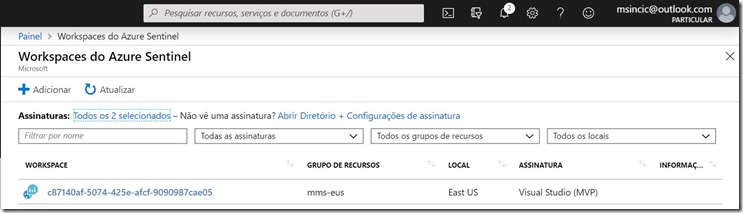

Uma vez criado o workspace do Log Analytics já é possivel fazer o vinculo.

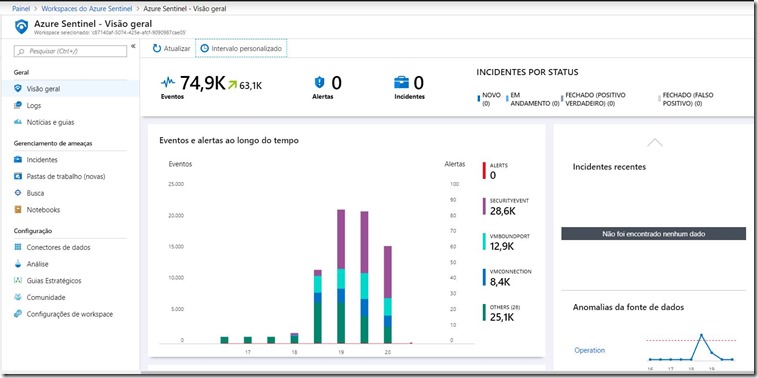

Com o workspace aberto já é possivel ter um overview dos dados coletados, nada muito sofisticado mas o suficiente para acompanhar o que está sendo analisado

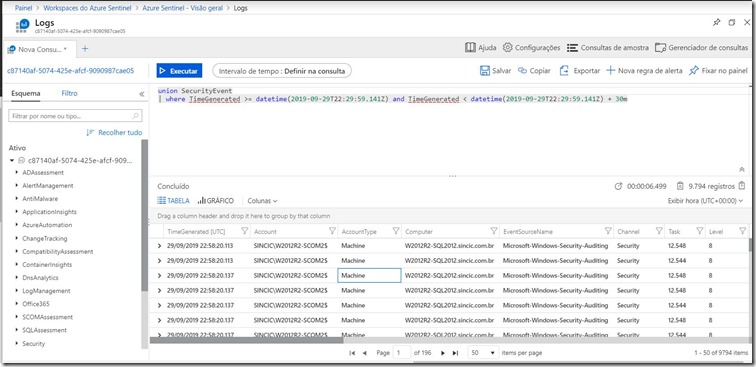

Ao clicar em qualquer um dos itens resumidos pode-se abrir o log do que gerou os alertas ou anomalias

Como Definir o Que Será Analisado

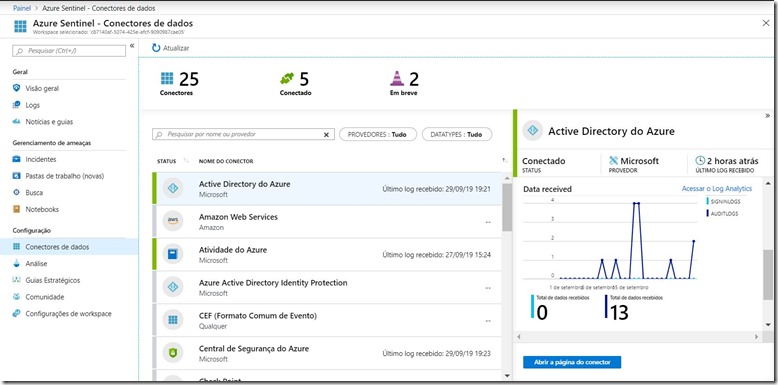

No console do Sentinel é possivel ver a aba “Conectores” onde temos diversos conectores já criados e disponiveis, alguns como preview e indicados quais já foram vinculados.

Veja no ultimo item que a cada diferente conector o custo passa a ser vigente, ou seja conforme o numero ou tipo de conector haverá a cobrança do processamento dos dados.

Para cada conector é necessário abrir a pasta de trabalho e configurar a conexão, por exemplo se for Azure indicar a subscrição e se for Office 365 o usuário para logar e capturar os dados. Como cada um dos conectores tem wizard é um processo bem simples de ser realizado.

Consumindo os Reports e Dashboards

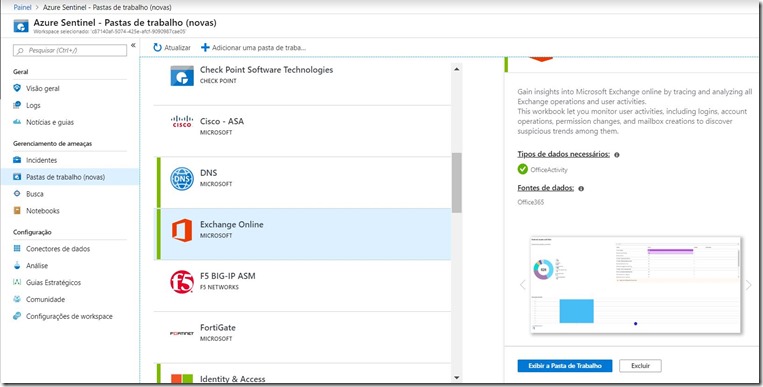

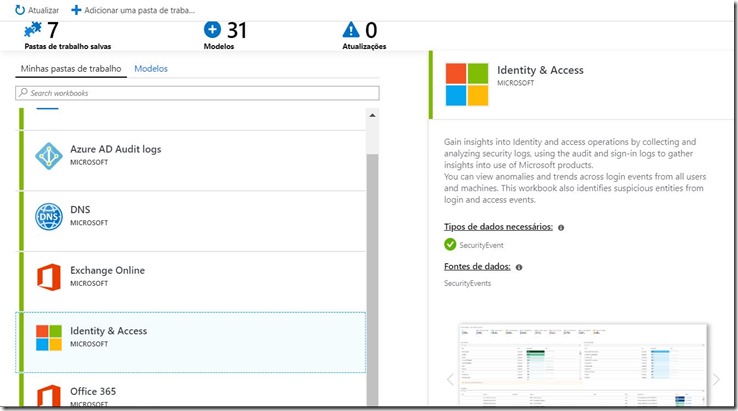

Na aba do Sentinel veja a opção “Pastas de Trabalho” onde podemos escolher quais os dashboards que queremos deixar disponiveis ou criar os seus próprio.

Por exemplo se eu clicar no conector de Exchange Online posso exibir ou salvar a pasta de trabalho com os seus reports já prontos.

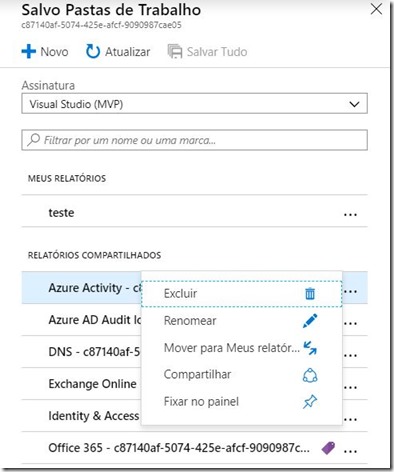

No caso acima veja que a opção de Salvar não aparece e sim a Excluir, uma vez que já salvei anteriormente como um dos dashboards (pasta de trabalho) mais utilizados.

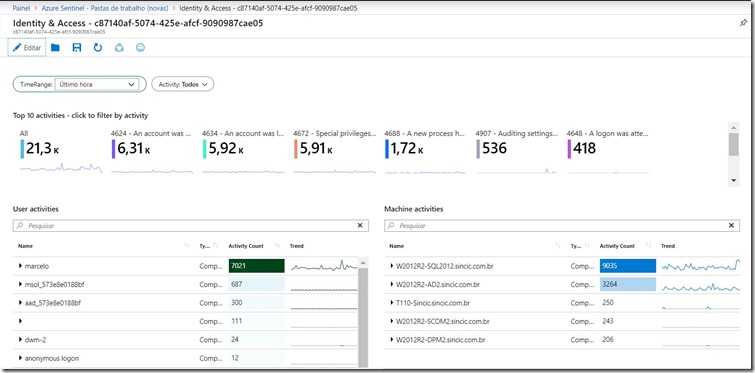

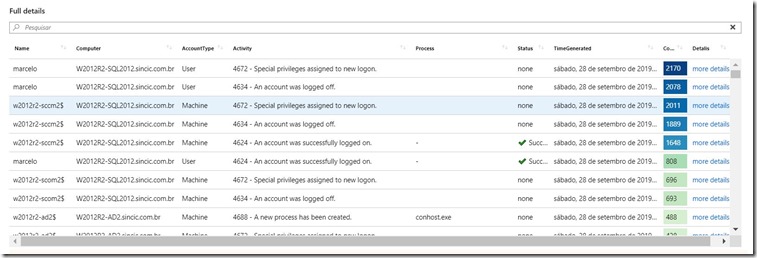

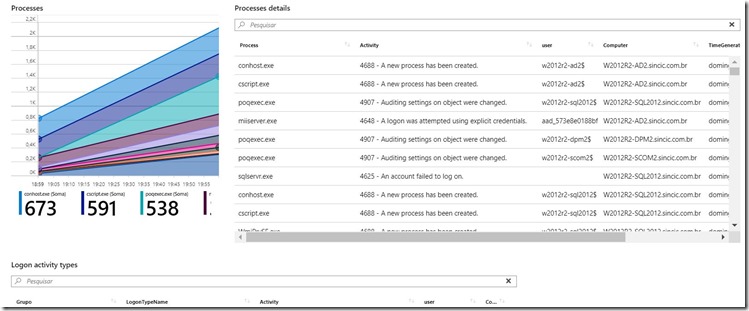

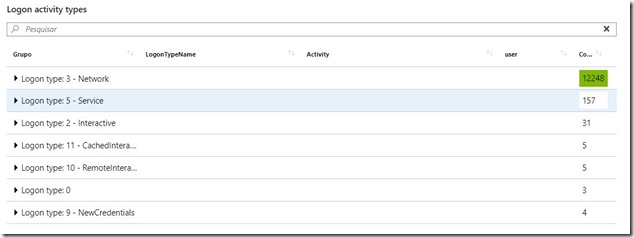

Ao clicar em Exibir podemos ver os detalhes do dashboard de analise de Identidade que fornece informações de login e segurança do meu ambiente

O nivel e detalhamento dos dados nos fornece uma visão real do que está acontecendo em determinado item de segurança conectado.

Compartilhando e Acessando os Reports (Dashboards)

Na mesma aba de “Pastas de Trabalho” mude para “Minhas pastas de trabalho” e poderá ver os que já salvou anteriormente ou customizou.

Neste exemplo já estão salvos 7 pastas (1 é customizada) com 31 modelos. As pastas são customizadas ou as já importadas dos modelos, enquanto o numero de “31 modelos” é porque um mesmo grupo de conectores tem mais de uma pasta, como é o caso do Office 365 que tem um conjunto de 3 diferentes reports.

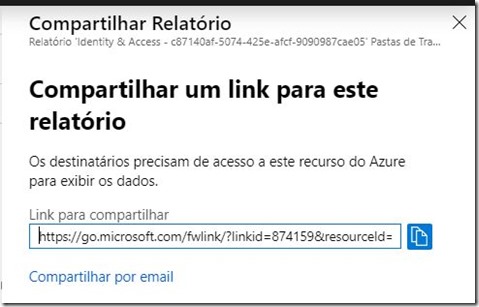

Ao acessar um dos reports é possivel ver o botão “Compartilhar” onde podemos gerar um link e enviar a outros ou utilizar para acesso fácil

Já para “pinar” ou fixar no painel inicial do portal do Azure um atalho utilize o icone de pasta na tela de preview e a opção “Fixar no painel” como abaixo

Quanto Custo o Azure Sentinel

Sabemos que os recursos de Azure são em sua maioria cobrados e o Azure Sentinel já tem seu valor divulgado em https://azure.microsoft.com/pt-br/pricing/details/azure-sentinel/

A primeira opção é adquirir em pacotes de 100 a 500GB por dia em modelo antecipado iniciando ao custo de $200/dia. Claro que o modelo antecipado é mais barato, mas só é útil se você consumir 100GB por dia, o que daria $7200/mês.

A segunda opção e util para quem irá analisar menos de 100GB por dia é o modelo de pagamento pós-uso ou por consumo ao valor de $4 por GB analisado.

Para saber o quanto está sendo analisado, veja a segunda imagem nesse artigo onde temos o total de dados “ingeridos”.

Importante: Se você coletar dados do Log Analytics o valor deve ser somado, já que o Log Analytics é uma solução independente.